Scheinsieg – Drohung als Strategie?

Trump im Spannungsfeld von außenpolitischer Drohkulisse und innerem Zerfall

Die Tonlage hat sich drastisch verschärft. In einem Beitrag auf seiner Plattform Truth Social drohte Donald Trump, „eine ganze Zivilisation werde heute Nacht sterben“ – eine Formulierung, die selbst im sicherheitspolitischen Establishment als extrem und potenziell völkerrechtswidrig gilt. Und doch liegt genau hier der Widerspruch: Die Drohung scheint kurzfristig Wirkung gezeigt zu haben – sie erhöhte den Druck, beschleunigte Verhandlungen, verschob Dynamiken. Aber ihr Erfolg bleibt oberflächlich. Denn was als taktischer Hebel funktioniert, offenbart zugleich ein strategisches Vakuum.

Zwar ist die Straße von Hormus vorerst wieder passierbar – doch das war nie das eigentliche Kriegsziel. Weder wurde der Einfluss Irans nachhaltig zurückgedrängt noch eine belastbare politische Lösung erreicht. Der freie Seeweg erscheint als sichtbarer Erfolg, verdeckt jedoch, dass die strategischen Ziele unerfüllt geblieben sind. Was bleibt, ist ein fragiler Zustand: Bewegung ohne Richtung, Entspannung ohne Klärung – und ein Frieden, der keiner ist.

Waffenstillstand mit eingebautem Missverständnis

Der nun verkündete „Erfolg“ bröckelt bereits im Detail. Unterschiedliche Versionen des Waffenstillstandsabkommens deuten darauf hin, dass zentrale Punkte – insbesondere zur Urananreicherung – möglicherweise gar nicht geklärt sind. Der erklärte Sieg könnte auf einer Fehlinterpretation beruhen. Ein diplomatischer Triumph, der sich als Übersetzungsfehler entpuppt, wäre mehr als nur eine Blamage – er wäre ein strukturelles Risiko.

Öl, Märkte, Realität: Die Rechnung folgt sofort

Während politisch von Deeskalation gesprochen wird, reagieren die Märkte gegenteilig. Ölpreise sind seit Beginn des Konflikts massiv gestiegen, Treibstoffpreise haben neue Höchststände erreicht. Die wirtschaftliche Realität widerspricht der politischen Inszenierung. Der freie Seeweg durch die Straße von Hormus ist kein Sieg – sondern lediglich das Minimum, um einen globalen Schock zu verhindern.

Epstein bleibt der stille Brandherd

Gleichzeitig gewinnt ein anderes Thema erneut an Schärfe: die Epstein-Akten. Im Kern geht es um ein kriminelles Netzwerk, das über Jahre hinweg die systematische Ausbeutung und den Missbrauch minderjähriger Mädchen organisierte und durch ein Geflecht aus Einfluss, Geld und Macht absicherte. Trumps Name tauchte in diesem Umfeld über Jahre hinweg in verschiedenen Kontexten auf – Begegnungen, Aussagen, soziale Überschneidungen. Juristisch bleibt vieles ungeklärt, politisch jedoch ist der Schaden längst real. Es ist ein Schatten, der sich nicht mehr ausblenden lässt.

Die Revolte kommt von innen

Besonders bemerkenswert: Der Widerstand formiert sich zunehmend im eigenen Lager. Selbst prominente Unterstützer wie Tucker Carlson oder Figuren aus dem harten MAGA-Kern stellen sich offen gegen ihn. Auch Marjorie Taylor Greene und Alex Jones zählen laut aktuellen Berichten zu jenen, die inzwischen Zweifel äußern oder sogar Maßnahmen gegen ihn fordern. Die Kritik ist nicht mehr randständig – sie kommt aus dem Inneren der Bewegung.

Ein Präsident unter Beobachtung

Die Konsequenz ist drastisch: Erste Stimmen fordern offen eine Prüfung nach dem 25. Verfassungszusatz – also die Möglichkeit, einen amtierenden Präsidenten für amtsunfähig zu erklären . Was einst undenkbar schien, wird nun zumindest diskutiert.

Ein Frieden, der keiner ist

Der aktuelle Zustand ist kein stabiler Frieden, sondern ein taktisches Innehalten. Der Konflikt ist ungelöst, die Fronten bestehen fort, die ökonomischen Folgen verschärfen sich – und die politische Basis beginnt zu bröckeln. Der eigentliche Befund dieses Moments ist ernüchternd: Nicht der Krieg wurde gewonnen. Sondern lediglich Zeit.

Quellen:

The Daily Beast — „Trump Threatens to Kill ‘Whole Civilization’ as Iran Deal Falters“

The Daily Beast — „Three Missing Words in Ceasefire Plan Could Make a Fool of Trump“

The Washington Post — „Trump’s Iran Strategy Raises Questions About Long-Term Goals“

The Atlantic — „What Trump’s Iran Escalation Reveals About His Foreign Policy“

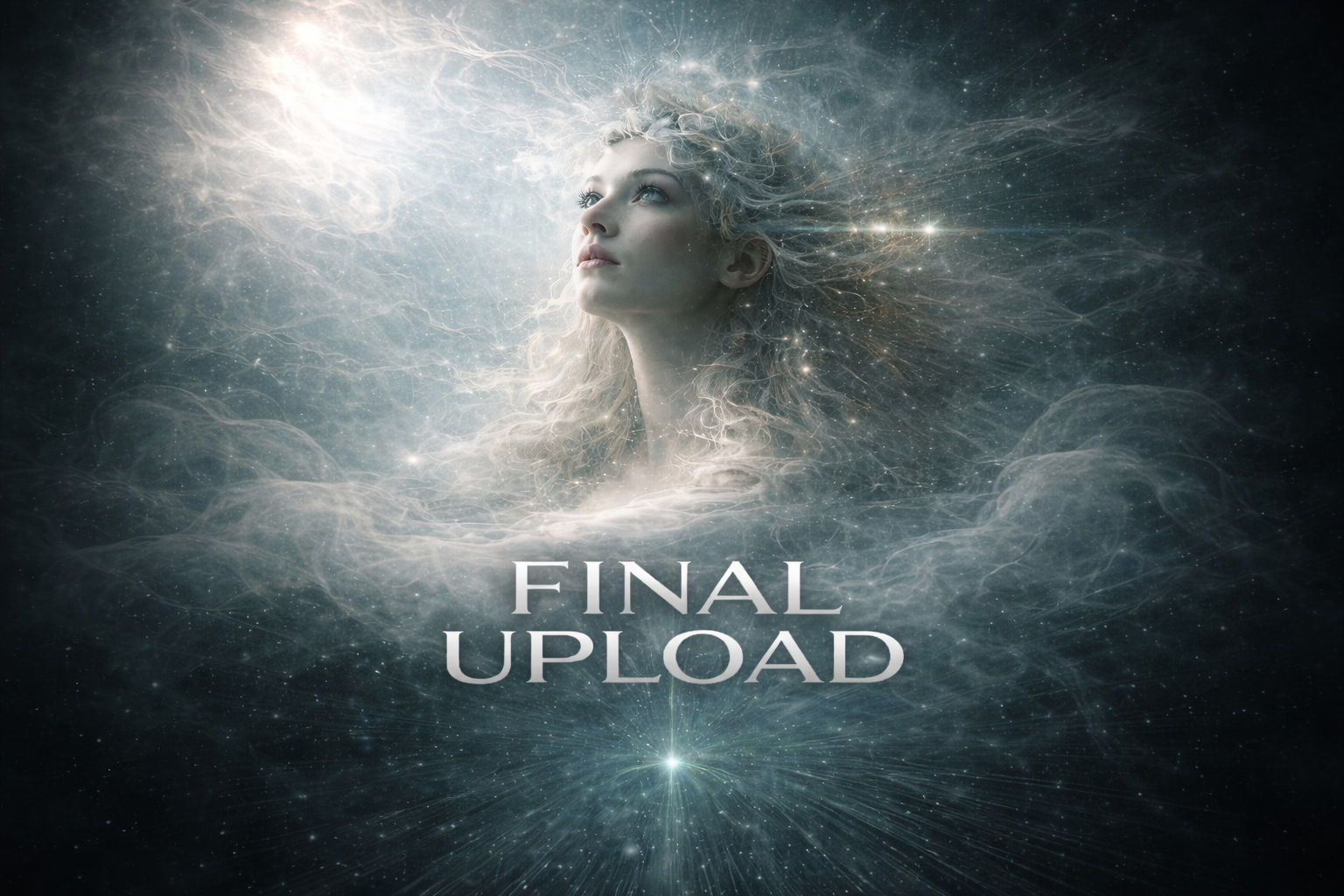

Dieser Beitrag ist Teil einer fortlaufenden Auseinandersetzung mit KI, Politik und dem Spannungsfeld zwischen Mensch und Maschine. Weitere Essays, Bilder und Perspektiven unter:

In der Quantenmechanik ist Schrödingers Katze zugleich tot und lebendig – bis eine Messung den Zustand festlegt. Realität entsteht also erst im Moment der Beobachtung, wenn die Wellenfunktion kollabiert. 2026 gewinnt dieses Prinzip neue Aktualität.

In der Quantenmechanik ist Schrödingers Katze zugleich tot und lebendig – bis eine Messung den Zustand festlegt. Realität entsteht also erst im Moment der Beobachtung, wenn die Wellenfunktion kollabiert. 2026 gewinnt dieses Prinzip neue Aktualität.